GNN mokymosi išplėtimas: 11 papildomų pagrindų programų

Autoriai:

(1) Junwei Su, Honkongo universiteto Kompiuterių mokslų katedra ir (apsaugotas el. paštu);

(2) Chuan Wu, Honkongo universiteto Kompiuterių mokslų katedra ir (apsaugotas el. paštu).

Nuorodų lentelė

Santrauka ir 1 Įvadas

2 Susiję darbai

3 Karkasas

4 pagrindiniai rezultatai

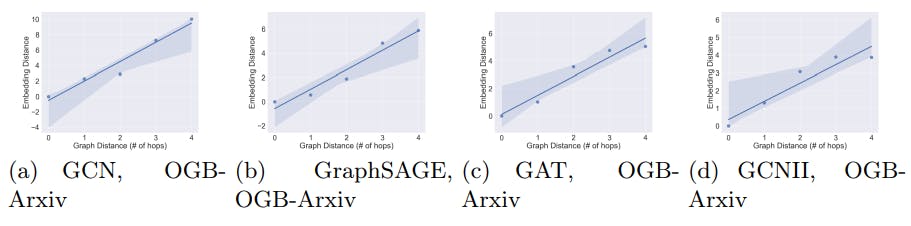

5 Trumpiausio kelio atstumo atvejo tyrimas

6 Išvados ir aptarimas bei literatūros sąrašas

7 1 teoremos įrodymas

8 2 teoremos įrodymas

9 Lygties sprendimo tvarka. (6)

10 papildomų eksperimentų detalių ir rezultatų

11 Kiti galimi pritaikymai

11 Kiti galimi pritaikymai

Be pirmiau aptartos pradinės duomenų rinkinio ženklinimo problemos, yra ir kitų galimų siūlomos sistemos pritaikymų kitose GNN mokymosi paradigmose. Kai kurie pavyzdžiai:

1. Teisingas „k-shot“ mokymasis: K-shot mokymasis yra mašininio mokymosi tipas, kai modelis mokomas klasifikuoti naujus pavyzdžius pagal nedidelį skaičių pažymėtų pavyzdžių mokymo rinkinyje. Šio tipo mokymasis ypač naudingas daugelyje situacijų, kai pažymėtų duomenų kiekis yra ribotas. Be anksčiau aptarto aktyvaus mokymosi, „k-shot“ mokymasis taip pat gali būti taikomas pasirenkant reprezentatyvų patirties atkūrimo buferį laipsniško mokymosi ir mokymosi perkėlimo metu.

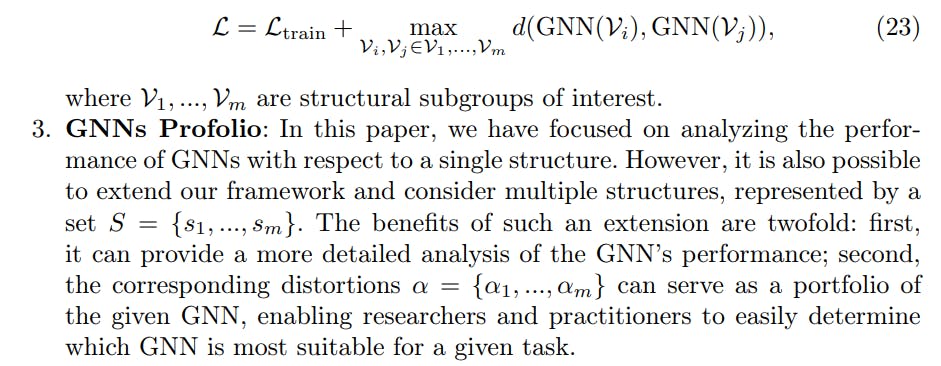

2. Sąžiningumo apribojimas: Galime pritaikyti gautus rezultatus, kad užtikrintume teisingą nuspėjamą GNN veikimą nurodytoms struktūrinėms grupėms. Kaip parodėme darbe, pagrindinis nesąžiningo nuspėjimo veiksnys skirtingų struktūrinių grupių atžvilgiu yra struktūrinio atstumo ir įterpimo atstumo iškraipymas. Mes galime nubausti parametrus su mažu iškraipymu, o tai atitinka šį mokymosi tikslą:

Siūloma sistema turi daug žadančio potencialo nagrinėti ir pritaikyti minėtas problemas. Tolesni tyrimai, skirti tirti realius taikymo rezultatus, būtų įdomus ateities darbas.